Casi la mitad de los periodistas encuestados en un nuevo informe dijeron que están utilizando herramientas generativas de IA no aprobadas o compradas por su organización.

Eso es según una encuesta realizada por Trint, una plataforma de software de transcripción de IA, que solicitó a los productores, editores y corresponsales de 29 salas de redacción globales cómo planean usar IA para el trabajo este año.

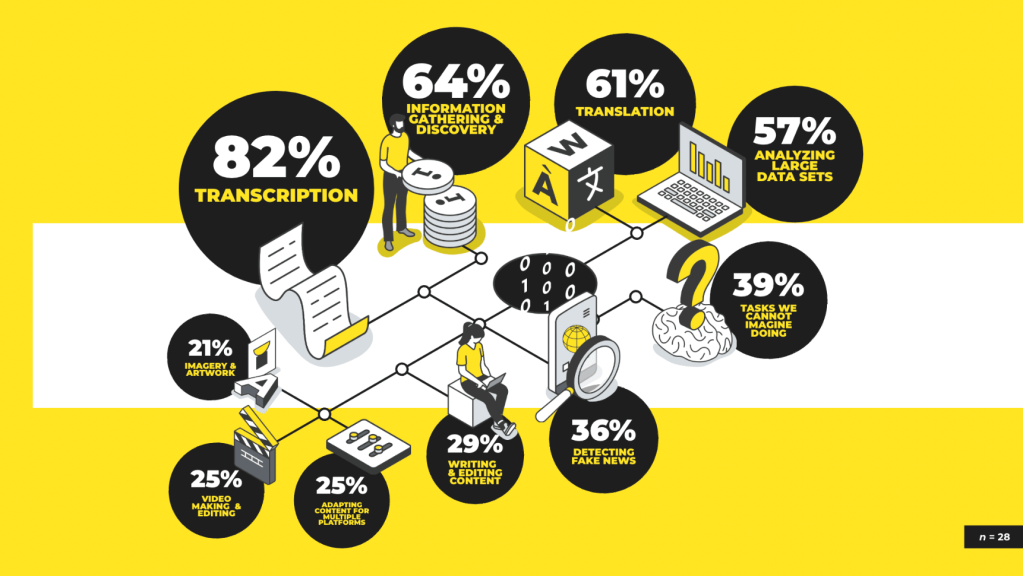

El informe encontró que el 42.3% de los periodistas encuestados están utilizando herramientas de IA generativas en el trabajo que no tienen licencia por su empresa. Los periodistas dijeron que sus salas de redacción estaban adoptando herramientas de IA para mejorar la eficiencia y mantenerse por delante de sus competidores, y esperaban usar IA para procesos como transcripción y traducción, recopilación de información y análisis de grandes volúmenes de datos para aumentar en los próximos años.

Trint’s Survey también encontró que solo el 17% de los entrevistados encontraron “Shadow AI”, o el uso de herramientas o aplicaciones de IA por parte de los empleados sin aprobación de la compañía, para ser un desafío que enfrentan las salas de redacción cuando se trata de implementar herramientas generativas de IA. Eso fue muy inferior a cuestiones como salidas inexactas (75%), riesgos de reputación de los periodistas (55%) y preocupaciones de privacidad de datos (45%).

“Un montón de personal editorial aquí usa AI de vez en cuando, por ejemplo, para reformatear los datos o como una herramienta de referencia”, dijo un empleado de negocios interno, quien habló con Digiday bajo condición de anonimato. “Algunos de ellos lo pagan con sus propios bolsillos”.

Según el informe de Trint, obtener ganancias de eficiencia fue la razón principal por la que las salas de redacción estaban adoptando IA generativa en 2025, según el informe de Trint, según el 69% de los encuestados.

Pero el empleado de Business Insider dijo que estos casos de uso para herramientas de IA generativas caen en un área gris. La guía de la gerencia de la empresa se ha centrado en principios, en lugar de órdenes específicas sobre lo que los empleados pueden y no pueden hacer con la tecnología, dijeron.

“Alentamos a todos en Business Insider a usar IA para ayudarnos a innovar de manera que no comprometa nuestros valores. También tenemos un Enterprise LLM disponible para que todos los empleados los usen ”, dijo un portavoz de Business Insider. (El editor anterior de Business Insider en Jefe Nicholas Carlson publicó un memorando en 2023 que describe estas pautas de la sala de redacción).

“No están aprobados [tools]pero no son desaprobados “, dijo el empleado, y agregó que se les ha aconsejado que no ingresen información confidencial en sistemas de IA generativos y que sean” escépticos de la salida “.

Un ejecutivo editorial, que intercambió el anonimato por franqueza, dijo que la tecnología de IA está evolucionando tan rápido que las empresas pueden tener dificultades para mantenerse al día con sus infraestructuras de cumplimiento corporativo, especialmente cuando se trata de seguridad legal y de datos.

“Creo que el riesgo de que el personal individual use estas herramientas es bastante pequeño … y creo que será muy difícil lograr que los empleados dejen de usar herramientas que realmente funcionen bien y faciliten su trabajo”, dijo el ejecutivo.

Felix Simon, investigador de IA y noticias de la Universidad de Oxford que estudia las implicaciones de la IA para el periodismo, le dijo a Digiday que todo se reduce a lo que los periodistas están utilizando la tecnología.

“No toda la IA no aprobada debe ser peligrosa”, dijo Simon. Por ejemplo, si un empleado descarga un modelo de idioma grande y lo usa localmente, eso no necesariamente sería un riesgo de seguridad, dijo.

Sin embargo, el uso de un sistema no aprobado conectado a Internet sería “más problemático si lo alimenta con datos confidenciales”, agregó.

El mejor enfoque, según el ejecutivo editorial, es explicar estos riesgos “de una manera realista que también incluye riesgos para ellos personalmente”.

Para mitigar las caídas de pitts asociadas con el uso generativo de la IA, el 64% de las organizaciones planean mejorar la educación de los empleados y el 57% introducirá nuevas políticas sobre el uso de IA este año, según el informe de Trint.

El New York Times aprobó el uso de algunas herramientas de IA para sus equipos editoriales y de productos hace dos semanas, informó Semafor. La compañía describió lo que el personal editorial puede y no puede hacer con la tecnología, y señaló que usar algunas herramientas de IA no aprobadas podría dejar fuentes e información sin protección.

Con información de Digiday

Leer la nota Completa > Los periodistas están utilizando herramientas de IA generativas sin supervisión de la empresa, descubre el estudio